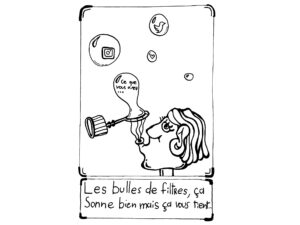

Bulles de filtres – ou comment TikTok menace la démocratie

Internet. La promesse d’une information abondante universellement disponible. Les réseaux sociaux, matrice d’une intelligence collective mondiale, gardiens de la liberté d’expression, berceau des amitiés qui transcendent les contraintes de l’espace-temps. Ça, c’était sur le papier. Mais en vrai, parfois, ces outils sont pervertis pour servir le capitalisme, isolent, fracturent le tissu social, et mettent à mal la démocratie…

Imaginez que vous vous rendiez dans un restaurant et que, sans vous en informer, on vous présente un menu contenant seulement une sélection des plats que l’on juge bons pour vous, selon vos goûts, votre lieu de résidence, votre budget et votre origine ethnique. La technique est efficace et vous avez de bonnes chances de retourner dans ce restaurant qui vous propose systématiquement des plats qui vous plaisent, mais peu d’opportunités de vous 0uvrir à d’autres cuisines.

Sur Internet, c’est pareil. Chaque fois que vous faites une recherche sur Google, naviguez sur la toile ou consultez votre fil d’actualité sur les médias sociaux, ce que vous voyez a été spécialement sélectionné pour vous. Vous êtes, à votre insu, prisonnier·e d’une « bulle de filtre ».

Selon Eli Pariser[1], à qui l’on doit ce terme, le phénomène de bulle de filtre est à la fois la sélection de l’information qui parvient à l’internaute et l’isolement intellectuel et culturel généré par ce tri. En gros, les algorithmes de recommandation des médias sociaux (YouTube, Facebook, Twitter, Instagram, TikTok, etc.) s’appuient sur les données collectées sur vous (les sites que vous fréquentez, vos recherches sur Internet, vos habitudes d’achat, vos « likes », les personnes que vous suivez…) et sélectionnent quasi uniquement du contenu susceptible de vous plaire. Au final, vous évoluez à votre insu (!) dans un environnement virtuel personnalisé – une bulle – dans lequel vous ne consommez que du contenu en accord de près ou de loin avec vos idées politiques et sociétales. Sur Internet, notre temps de cerveau disponible est une ressource rare pour laquelle se battent les entreprises. Plus longtemps nous restons sur un site web ou un fil d’actualité, plus nous sommes exposé·es à de la réclame, et donc plus nous sommes susceptibles de consommer. En bref, notre temps, c’est de l’argent pour les autres. C’est l’économie de l’attention. Pour cela, les algorithmes de recommandation personnalisent les contenus que nous consommons en fonction de nos préférences, afin de capter, et garder, notre attention.

Soit, mettons qu’on ne me propose que le schnitzel à l’Odéon et que j’aie peu de chance de découvrir le couscous, mais à part ça, où est le problème ?

Premièrement, les bulles de filtre occultent une partie des données quasi infinies théoriquement disponibles sur la toile. En cela, elles réduisent à une information unilatérale nos moyens de nous constituer une opinion. Elles agissent comme un tamis, dont résulte une perte de l’esprit critique.

Deuxièmement, elles renforcent nos points de vue et nos préjugés parce qu’elles suppriment les pensées alternatives et les opinions politiques divergentes.

Troisièmement, parce qu’elles renforcent certains biais cognitifs, comme le biais de confirmation, ou l’effet de répétition, qui fait que plus nous voyons une information, plus nous pensons qu’elle est vraie, les bulles de filtres favorisent la circulation des infox (Fake News). Et comme nous sommes si peu habitué·es à des avis contradictoires, nous ne prenons même plus la peine de vérifier nos informations avant de les valider et de les partager.

Enfin, parce qu’une grande partie de la population s’informe sur les médias sociaux, il se crée des fractures sociales entre des groupes d’opinions différentes : la population se scinde, se polarise et se radicalise. Souvenez-vous du débat enflammé autour du vaccin contre le COVID…

Ajoutez à cela que de nombreux comptes très actifs sur Twitter ou Facebook, par exemple, sont des robots2 et qu’il sont parfois destinés à manipuler l’opinion politique, comme dans l’affaire Cambridge Analytica : en 2016, les médias sociaux ont été exploités pour influencer les intentions de vote d’électeurs-clé lors de la campagne présidentielle américaine, et, deux ans plus tard, pour faire pencher la balance en faveur du Brexit. Récemment, les « Twitter bots » ont encore sévi pour manipuler l’opinion publique sur le conflit russo-ukrainien.

Bref, méfions-nous : sur Internet, un « menu sans couscous » n’est pas aussi innocent qu’il paraît…

[1]entrepreneur militant et fondateur de avaaz.org, le site de pétition sur Internet

[2]5 % des comptes selon Twitter, et jusqu’à 20 % selon certaines estimations indépendantes.

Texte :

Martin Gunn est ingénieur en robotique mais n’a pas de smartphone, il est absent des médias sociaux mais probablement accro à YouTube, et les ami·es comme les cookies, il les préfère dans le monde réel plutôt que dans le virtuel.

Illustration :

Dimitri Roulin, 19 ans, est étudiant en art visuel et passionné par l’illustration, et en particulier les dessins de presse satirique afin d’être actif face aux défis de notre époque (environnementaux et sociaux).